【虹科方案】虹科 GNSS 模擬器高斯噪聲解析 – 提升定位精度與接收機性能

深入解析虹科 GNSS 模擬器中高斯噪聲對定位效果的影響。了解如何透過科學模擬提升接收機性能與定位精度,適用於香港及東南亞 B2B 技術測試環境。

Lorem ipsum dolor sit amet, consectetur adipiscing elit. Ut elit tellus, luctus nec ullamcorper mattis, pulvinar dapibus leo.

Lorem ipsum dolor sit amet, consectetur adipiscing elit. Ut elit tellus, luctus nec ullamcorper mattis, pulvinar dapibus leo.

在自動駕駛感知系統的研發過程中,模型性能高度依賴於大規模、高品質的感知數據集。目前業界廣泛使用的公開數據集包括 KITTI、nuScenes、Waymo Open Dataset 等,這些數據集為自動駕駛演算法的研究與落地奠定了重要基礎。

然而,構建真實世界的感知數據集並非易事——不僅需要投入大量人力、物力與時間成本,同時還面臨數據採集受限、隱私與合規要求、標註工作耗時,以及極端場景難以獲取等多重挑戰。

在此背景下,高保真虛擬數據集正逐步成為自動駕駛感知演算法研究的重要發展方向。透過仿真平台生成的虛擬數據,不僅能快速擴充數據規模,還可靈活構造複雜交通場景、惡劣天氣條件與罕見事件,為模型提供更加全面與多樣化的訓練樣本。

基於此,虹科正式推出全新的高保真虛擬數據集 —— SimDataThe

SimData 依託 aiSim 仿真平台的高精度物理建模與擬真視覺渲染能力,可生成多傳感器同步數據(包括 Camera、LiDAR、Radar、IMU 等),實現與真實世界數據高度一致的多模態特性。

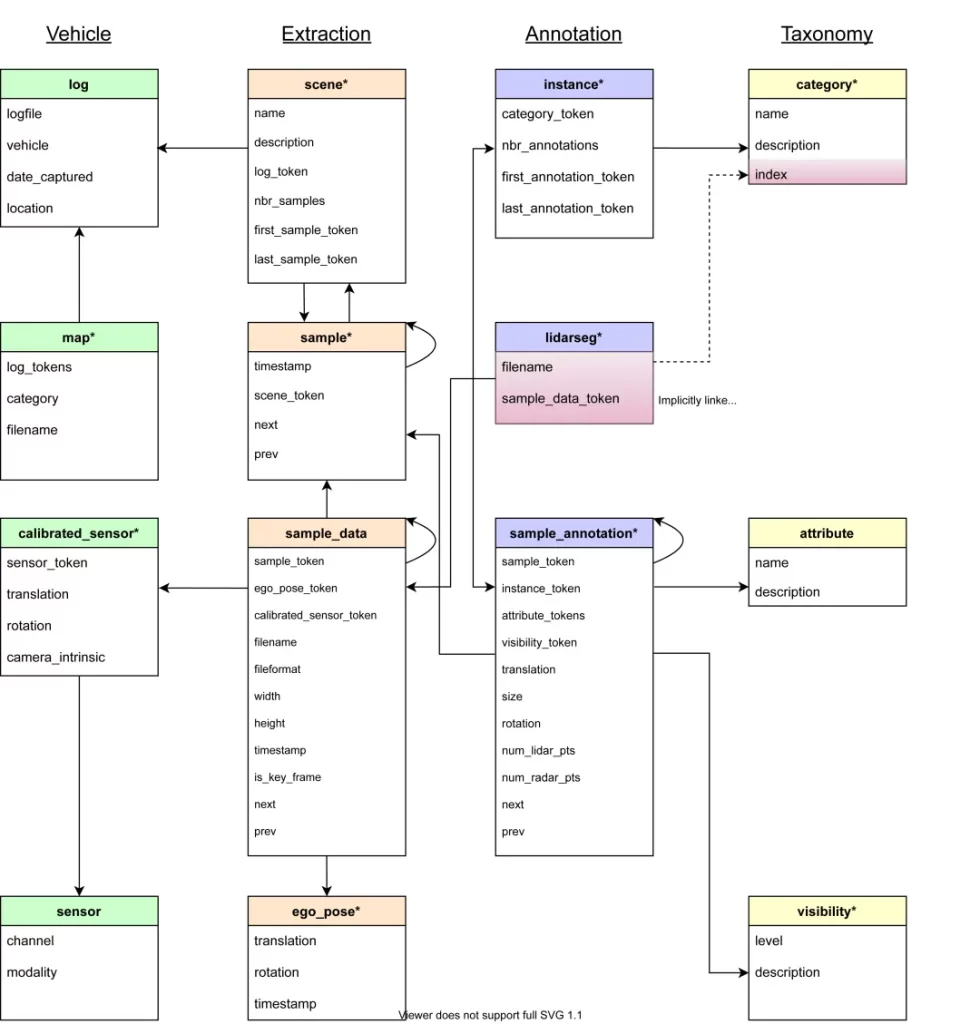

SimData 的數據結構嚴格遵循 nuScenes 數據集格式規範,可直接使用官方 nuscenes-devkit 工具進行解析與可視化,大幅降低開發者的使用門檻與整合成本。

本文將介紹 SimData 的核心特性與構建流程,並展示其在典型感知任務中的應用表現。SimData 正式版本及相關對比測試報告將於近期發布,敬請持續關注虹科的最新動態。

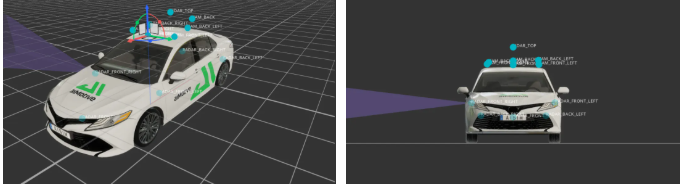

在 aiSim 仿真平台中,我們嚴格復現 nuScenes 數據集的傳感器佈局設計,以確保數據結構與多模態同步特性的高度一致性。

仿真車輛配置如下:

其中,相機與雷達的採樣頻率為 40 Hz,激光雷達採樣頻率為 80 Hz,可滿足高時間精度的多傳感器同步採集需求。

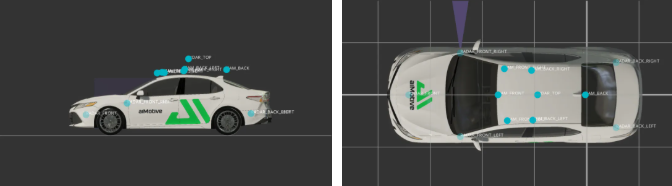

各傳感器的空間佈設與朝向如下圖所示:

與 nuScenes 不同的是,SimData 中所有傳感器均採用 FLU(Forward–Left–Up)坐標系;而在 nuScenes 數據集中,相機傳感器使用的是 RDF(Right–Down–Forward)坐標系The

在數據構建過程中,我們對所有標註文件進行了嚴格的坐標系轉換與對齊處理,確保邏輯定義與 nuScenes 完全一致。

因此,使用者在應用 SimData 時,無需額外處理坐標差異,其數據解析流程與開發體驗可與 nuScenes 保持一致。

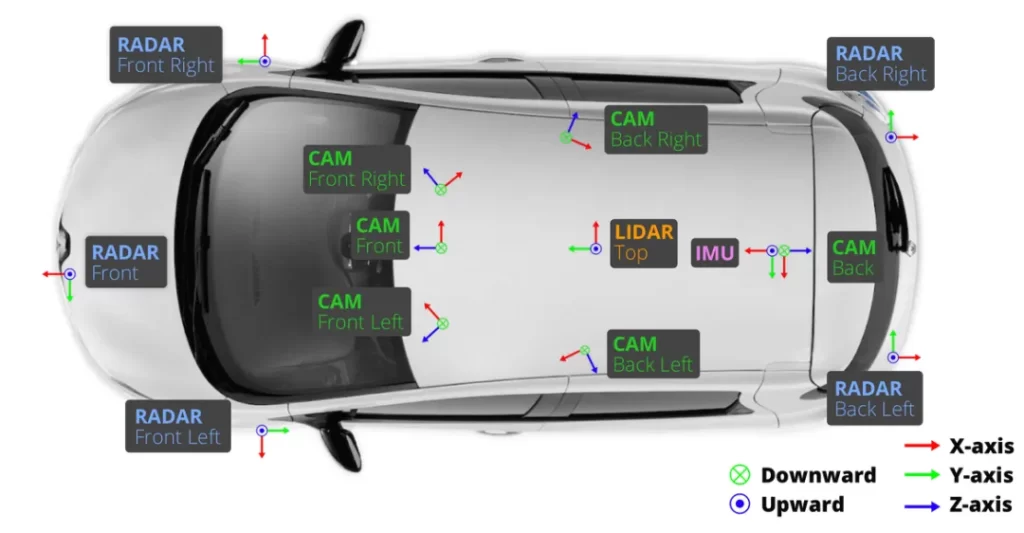

SimData 數據集在整體結構設計上與 nuScenes 完全對齊。對於已熟悉 nuScenes 的開發者而言,無需額外適配或學習成本,即可快速上手。

整體目錄結構如下(與 nuScenes 組織形式一致):

maps 文件夾

存放數據集中使用的所有高精地圖影像文件,用於提供地理位置資訊與場景背景參考。

samples 文件夾

存放各類傳感器的關鍵幀數據,包括:

每 0.5 秒 抽取一幀作為關鍵幀保存。

sweeps 文件夾

保存除關鍵幀以外的連續傳感器數據,用於構建時序資訊與多幀融合任務。

v1.0-* 文件夾

存放傳感器標註與元數據資訊,全部採用 .json 格式,涵蓋:

其 JSON 關聯結構與 nuScenes 完全一致。

在 SimData 中,每個數據資訊塊均透過全域唯一識別碼 UUID(Universally Unique Identifier) 作為 token 進行標識。

這些 token 構成了不同數據之間的關聯橋樑。使用者可透過以下三個核心文件獲取絕大多數標註與結構化資訊:

sample.json

記錄關鍵幀(Keyframe)的基礎資訊:

sample_data.json

包含對應幀的多傳感器數據詳情:

sample_annotation.json

記錄每個關鍵幀中的目標物體資訊,包括:

SimData 可直接透過 nuscenes-devkit 解析,使用方式與 nuScenes 完全一致:

使用官方工具即可進行分析與模型訓練。結合 cv2 或 matplotlib 可完成數據可視化,包括:

使用在 nuScenes 上訓練的 BEVFormer-Tiny 權重(未在 SimData 上重新訓練)進行直接推理,驗證數據可用性。

本文闡述了虛擬數據集在自動駕駛感知研究中的重要性,並介紹了基於 aiSim 仿真平台生成的高保真虛擬感知數據集 —— SimDataThe

文章詳細說明了 SimData 的數據結構與使用方式,並透過開源感知模型進行檢測驗證,證明其可用性與有效性。

後續,虹科團隊將發布更詳盡的測試與對比報告,以進一步驗證 SimData 與真實數據集之間的高一致性。

透過這一系列工作,我們不僅驗證了 aiSim 仿真環境的高保真特性,也為研究人員與開發者提供了一套高品質、易於使用且具可擴展性的虛擬感知數據資源,持續助力自動駕駛感知演算法的研究與模型訓練。

深入解析虹科 GNSS 模擬器中高斯噪聲對定位效果的影響。了解如何透過科學模擬提升接收機性能與定位精度,適用於香港及東南亞 B2B 技術測試環境。

虹科MSR衝擊振動記錄器可為物流運輸、軌道運輸、電力能源、工業自動化等領域提供高精度、可靠的衝擊振動監測解決方案。透過引入虹科MSR165衝擊微型振動記錄儀,海信日立成功建構了一套科學的數據監測體系,實現了對設備運輸環境的精準量化與產品設計的持續優化。

虹科 PCAN Router 提供 CAN / CAN FD 通訊橋接解決方案,支援跨 EE 架構信號轉換,無需修改 ECU 軟件即可完成 POC 驗證與測試整合,適用於汽車電子、自動駕駛與車載系統開發。