【虹科方案】GNSS 模擬器助力物流運輸定位測試 – 虹科 MSR 數據記錄驗證方案

虹科 GNSS 模擬器協助 HK-MSR175Plus 運輸數據記錄儀完成定位精準度與抗干擾測試,提升物流運輸監測效率,支援全球路徑模擬與異常情境驗證。

Lorem ipsum dolor sit amet, consectetur adipiscing elit.Ut elit tellus, luctus nec ullamcorper mattis, pulvinar dapibus leo.

Lorem ipsum dolor sit amet, consectetur adipiscing elit.Ut elit tellus, luctus nec ullamcorper mattis, pulvinar dapibus leo.

隨著端到端(End-to-End)自動駕駛架構的興起,傳統基於規則的仿真測試正遭遇「真實感不足」與「場景泛化難」的雙重瓶頸。

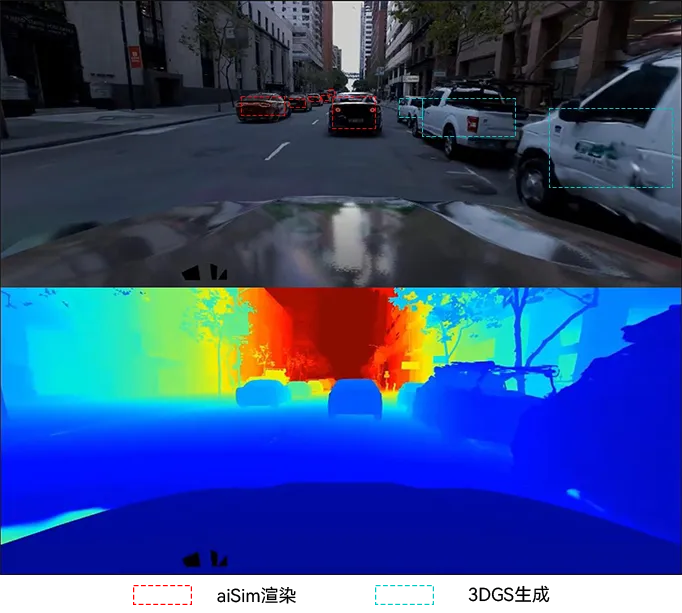

本文將深度拆解虹科(Hongke)推出的雙模態仿真測試解決方案:一方面依託 aiSim 提供確定性的物理級傳感器建模;另一方面通過 World Extractor 實現基於 3DGS/NeRF 的自動化世界重建。我們將重點探討這兩者如何透過混合渲染(Hybrid Rendering)技術路線,在保留真實世界視覺保真度的同時,實現動態交通流的泛化,構建可用於閉環驗證(Closed-loop Verification)的數字孿生(Digital Twin)環境。

自動駕駛仿真測試的核心矛盾,長期存在於「物理真實性(Realism)」與「仿真可控性(Controllability)」之間。虹科基於此構建了兩條既獨立又互補的技術路線,形成了完整的工具鏈生態:

這兩條路線並非孤立,而是透過混合渲染架構在終端匯聚,為高階智駕提供「靜態環境真實、動態目標可控」的閉環測試能力。

aiSim 並非僅為神經渲染服務的播放器,而是一款獨立、基於物理的高性能全棧仿真平台。它集成了動力學仿真、天氣環境系統、物理傳感器模型及場景編輯等自動駕駛測試關鍵功能,更是全球首個通過 ISO 26262 ASIL D 認證的仿真平台。其核心價值在於為端到端智駕系統提供高保真、確定性的輸出,並進行有效的閉環測試。

不同於基於遊戲引擎(如 UE/Unity)的方案,aiSim 採用自研且基於 Vulkan API 的渲染管線:

aiSim 深入物理特性層面,提供極致建模:

針對傳統手工建模週期長、成本高的痛點,World Extractor 提供了一套成熟的端到端自動化工具鏈,將現實世界高效轉化為數字資產。

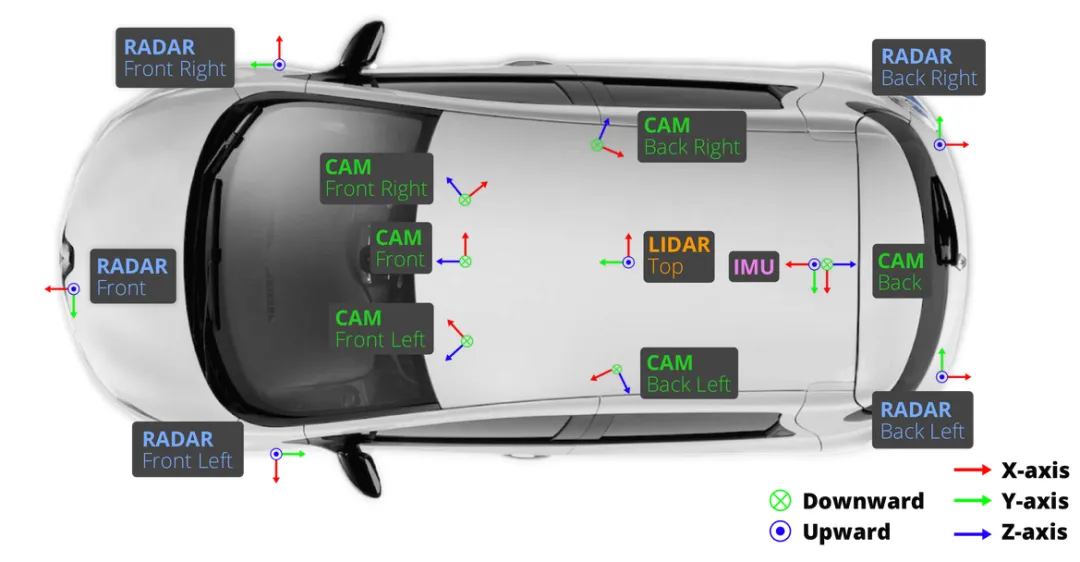

高質量的重建源於高質量的數據。虹科定義了嚴格的傳感器部署規範:

這是虹科方案的核心技術壁壘。單純的 3DGS/NeRF 雖視覺逼真,但本質是「三維錄像」,難以交互。為實現閉環測試,我們採用了解耦技術:

基於上述架構,虹科實現了從「復現」到「泛化」的技術跨越:

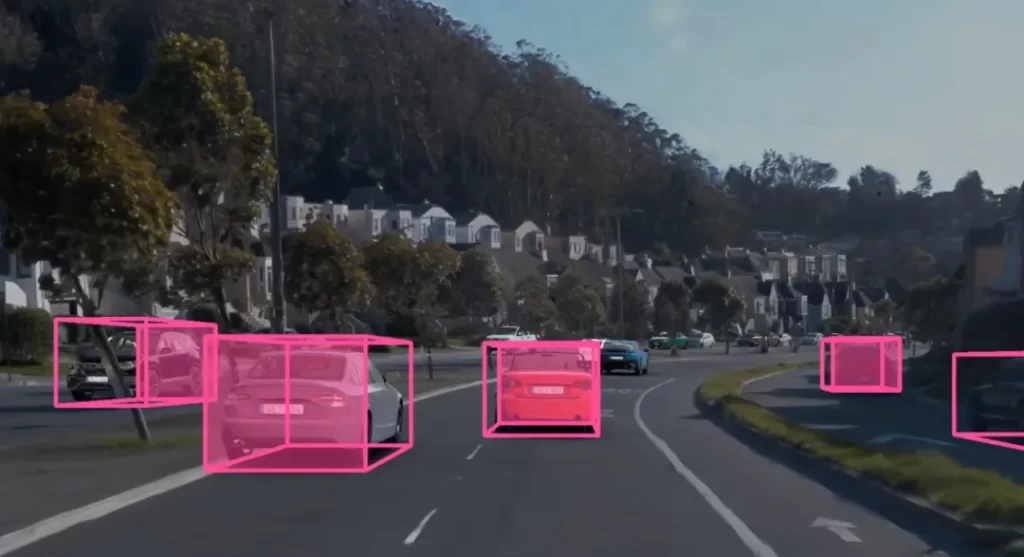

在重建的高保真地圖中,測試人員可透過 OpenSCENARIO 自由配置交通流,生成擁堵、Cut-in(切入)或事故場景。這極大地擴展了 ODD(運行設計域) 的覆蓋範圍,精準攻克感知算法在路測中難以遇到的 Corner Case(邊緣場景) 痛點。

該工具鏈已在多家 OEM 及 Tier 1 供應商中驗證,支持主流域控平台的硬件在環(HiL)集成:

虹科的雙模態仿真測試解決方案,透過 NeRF2GS 技術將真實世界「搬進」仿真器,並利用 aiSim 物理引擎 讓世界「活」了起來。這種「靜態環境高保真,動態場景全泛化」的混合渲染模式,為從感知到規控的端到端閉環驗證提供了行業領先的數據底座,顯著降低了對高成本實際路測的依賴!

虹科 GNSS 模擬器協助 HK-MSR175Plus 運輸數據記錄儀完成定位精準度與抗干擾測試,提升物流運輸監測效率,支援全球路徑模擬與異常情境驗證。

SimData 為基於 aiSim 仿真平台生成的高保真虛擬感知數據集,支援 Camera、LiDAR、Radar、IMU 多傳感器同步數據,結構完全對齊 nuScenes,可直接使用 nuscenes-devkit 進行解析與模型訓練。

虹科 AR 遠程醫療解決方案整合醫療級 AR 智慧眼鏡、AI 即時翻譯與遠程會診技術,支援跨語言醫療溝通、臨床教學與國際醫療合作,推動智慧醫療流程數位化升級。